ちょっと話題が遅れましたが、先日ChatGPTを開発したOpenAI社の現役社員、旧社員の署名が世間を賑やかしました。

このままでは、OpenAI社の現役社員までが「人類絶滅の恐れ」のリスクがあると警鐘を鳴らしたのです。

署名者(アルファベット順):

ジェイコブ・ヒルトン: 旧OpenAI

ダニエル・ココタイロ: 旧OpenAI

ラマナ・クマール、: 旧Google DeepMind

ニール・ナンダ: 現在はGoogle DeepMind、以前はAnthropic

ウィリアム・サンダース: 旧OpenAI

キャロル・ウェインライト: 旧OpenAI

ダニエル・ジーグラー: 旧OpenAI

匿名: 現在OpenAI

匿名: 現在OpenAI

匿名: 現在OpenAI

匿名: 現在OpenAI

匿名: 旧OpenAI

匿名: 旧OpenAI

推薦者(アルファベット順):

ヨシュア・ベンジオ

ジェフリー・ヒントン

スチュアート・ラッセル

この署名を読むと、AIによる様々なリスク、最悪のケースについては

「自律型AIシステムの制御の喪失による人類絶滅の可能性」

を認識している。と署名により改めて表明しています。

過去にも似たような話題はたくさん出てきました。映画や小説でもありふれた話ですよね。

生成AIが登場するまでは、

「またSFっぽい話が出てきたな」、

「まだ遠い未来のことなので、自分たちには関係ない」

と思っていましたが、この程度の署名で世間がざわつくのは、生成AIのパワーを体験した今となっては、わりと目前に迫ってきたリスクというのをみんな実感してきているからではないでしょうか?

ChatGPTが登場したのが2022年11月のことでした。

現在2024年6月なので、まだ2年経ってない状況ですが、当初はチャットだけだったものがマルチモーダル化が進み、今では画像も音声も高精度でAIとやりとりできるようになりました。

動画も映画のようなものが簡単に作れてしまいます。

文章も動画も人間が作ったものなのかAIが作ったものか見分けがどんどんつかなくなってきています。

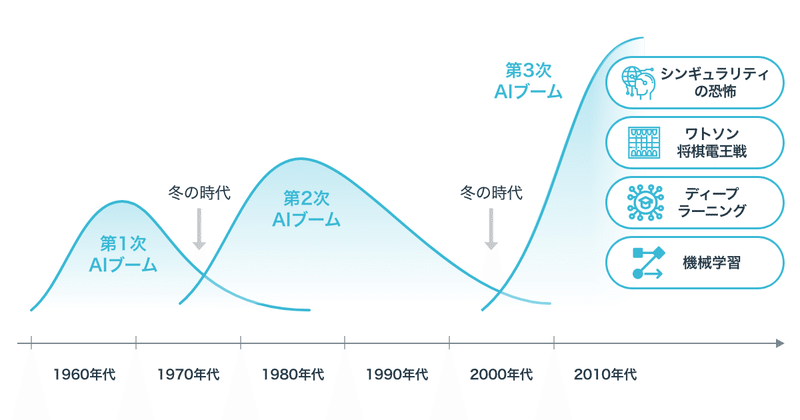

以下のAIの歴史を見ても、驚異的な加速度で指数関数的に技術が進歩しているのが見て取れると思います。

第3次AIブームはディープラーニングの時代で、画像認識程度ができるくらいでした。

この時点でも多少「すごいなー」とは思っていましたが、あまり庶民に直接影響のある技術でもなかったので、第3次AIブームも沈静化しつつあるところでした。

そんな中で2022年11月にChatGPTが登場しました。

第2次AIブームの後の冬の時代は長かったですが、第3次AIブームから生成AIの登場までは、年表で見てみるとほぼ谷間がありません。

生成AIのブームもいずれ落ち着くとは思いますが、ブームが去るというよりは「日常生活にAIが浸透」することによって、今後はAIが使われることが当たり前になっていきそうですね。

パソコン、スマホ、家電、車、電車、飛行機、機械・・・とあらゆるところにAIが組み込まれ始めています。

すさまじい勢いでAIが生活の中に入り込んできています。

AI技術の進化により、「自律型AIの制御不能による人類滅亡」も映画や小説だけの話ではなく、「注意しないと本当にあり得る話」に近づいて来ているため、OpenAI社の社員も警鐘を鳴らしているのです。

「さすがに開発者もバカではないから、そんなのわかってるのでは」

「そこまで危険なもの企業では作らないでしょ」

という考えもあると思いますが、「企業の目的は何だろう?」と考えた時に、企業にとってはどうしても「利益」というインセンティブが大きな命題となってしまうため、歯止めが利かない可能性があります。

僕たちがご飯を食べないと生きていけないように、企業は「利益」が無いと存続できません。

企業が存続できなければ「社員」も食べていくことができません。

「AIが危険」とわかっていても、目先の「利益」がないと食べていけないのです。

資本主義で競争原理が働く以上は、「利益」が大きなインセンティブとなります。

AIの進化は簡単には止められないのです。

なので、政府もAIの国際ルールを急遽定めようとしています。

これまでも産業革命、コンピュータ、インターネット、スマホなど、生活に便利なものがたくさん登場してきました。

AIもその一部なので、

「そうはいってもAIによって生活が便利になるだけで、AIの国際ルールもできるし、今回の署名も騒ぎ過ぎでは?」

という思いもありましたが、ふと気になることを思い出しました。

それは、

「人間は虚構を信じる能力がある。だから人類が反映した」

という話です。

「ユヴァル・ノア・ハラリ」著の「サピエンス全史」で語られた概念です。

虚構とは?

「ユヴァル・ノア・ハラリ」著の「サピエンス全史」を読んだ方はわかると思いますが、そのサピエンス全史では、

「人間は虚構を信じる能力があるがゆえに繁栄した。」

ということが提唱されています。

人間は言語によって、想像上の事象について語る能力を身につけました。

この想像上の事象が「虚構」です。

それによって同じ思想をもった人どおしで集団を形成することができるようになり、組織的な狩りや共同作業により、他の生物より繁栄できるようになりました。

現在の人類であるホモサピエンスが、体格に優れたネアンデルタール人より繁栄して生き残ったのは、この「虚構」を言語によって生み出し、そして「虚構」を信じることができるか。の違いがあったと言われています。

昔の人類の行動には、神話や言い伝え、宗教などの影響が大きかったと考えられます。

今では国家ごとの国民意識なども、教育によって根付いてるところがあると思います。

このように、まったく赤の他人同士が共通の思想を持つことが言語によって生み出された「虚構」によって可能になっています。

平たくいうと、「妄想する能力」、「妄想してそれを信じる能力」と言えます。

日本人は無宗教な人も多いですが、海外ではご存知のとおり神様を信じる人も多いです。宗派が選挙にも大きく影響するくらいの影響力があると言われています。

繰り返しになりますが、「妄想する」、そして「妄想を信じる」ことができるのです。

この妄想力は「未来を見通す力」にもなり、創造力の源にもなるので人間ならではの能力で、近代化が進んだのもこの「妄想力」のおかげです。

今では会社の組織で、目標に向かってチームとして個人では到底成し遂げられない価値を創造する事もできます。

新しいビジネスを考える際も、未来を妄想して言語化する必要がありますよね。

他の人に伝えるために「虚構」が必要になるのです。「虚構」を生み出す手段が言語によるコミュニケーションです。

言語化しなければ、「虚構」を共有することができません。

あと、将来のリスクや危険を予知することもこの妄想力による「虚構」が重要になります。

原始時代の人であれば、「あの山にやクマがたくさんいるので危険だ」ということを周りの人に伝えることが必要でしょう。

昔の人であれば、時には「あの山には鬼がいるから近寄ってはいけない」という言葉で伝えたのかもしれません。

「鬼がいる」というのは言語によって作られた「虚構」ですが、子供たちや世の中を知らない人にとっては、信じるに値する「虚構」だったのかもしれません。

このように「虚構」というのは、危険を回避するためにも便利な手段でした。

一方で、人間はこの虚構を信じる「妄想力」にも苦しめられてきました。

まだ起こってもいないことに対して「不安」になったり、「心配」したり「憂い」を持ったり、ネガティブな方向にも「妄想力」を発揮するようになってしまいました。

今考えても仕方ないことや、考えても具体的なアクションにつながらないことを、グルグル考えをめぐらせてどんどん沈んだ気持ちになってしまうのも、「妄想を信じる」がために苦しむのです。

「老後の年金少なくなるけど、生活できるかどうか心配。」

「病気で入院することになった。このまま治らなかったらどうしよう。」

「あの人は挨拶しても返事してくれなかった。自分はきっと嫌われてるに違い無い」

・・・という考えも、人間は「妄想」してしまうからなのです。

エンジニアもよくどうでもいいことで「妄想力」を発揮して苦しみます。

「頼まれたことがうまく進んでないけど、できてないって報告したら怒られそう。どうしよう・・・」

とか

「わかりません。って自分から言いにくいから、とりあえず適当にやって相手から指摘されるのを待とう・・・」

とか、余計な「妄想」によって合理的な判断ができず、ますます不都合な事態になってしまうことも多々あるでしょう。

「虚構」というのは人類の繁栄にとって必要不可欠なものでしたが、近年ではデメリットのほうも重大な問題として表面化してきています。

さて、話を戻してこれらの「妄想した世界」のことを「虚構」と呼んでいますが、これとAIが何の関係があるのでしょうか?

AIは虚構を作ることができる

これからが本題ですが、AIは虚構を作ることができます。

わかりやすくいうとフェイクニュースとか、ゴシップ記事とか、偽写真、偽動画とか「事実でない」情報が世の中溢れてますよね?

あからさまなフェイク情報に限らず、歴史の物語1つ見てみても、昔は言い伝えや書き物でしか情報が残ってないので、僕たちが教わった歴史も本当かどうかわからないことも多いのです。

にもかかわらず、教科書にのってるだけで「それは事実だ」という気持ちが強いと思います。

仮に「事実でない情報」だったとしても、人間は都合よく解釈して「事実だ」と思い込むことはよくあります。

それは、人間に「虚構を信じる能力」があるからです。

ここからが問題ですが、AIの力によってこの「虚構」が容易に作れるようになりました。

まるで本物の人間かのようなAIアバター。本物の人間がしゃべってるかのようなAIの音声。人間が作った文章にしか見えないメディアの記事・・・など、現実世界に存在しないAIだけで「虚構」が作り出せるようになりました。

今までも「映画」や「小説」など、虚構を作ることはできましたが、AIによって圧倒的なスピードで虚構が「量産」されていくのです。

虚構の量も圧倒的になってきます。

「虚構」の情報量が増えるにしたがって、徐々に「現実」と「虚構」の区別がつきづらくなってきます。

映画も映画とわかっていても感情移入してしまって、泣いたり笑ったり感情がゆさぶられると思いますが、人間は「虚構」を信じることができるので、感情移入ができるのです。

映画は「映画だ」という前提条件が最初にわかっているから、「現実」と「虚構」の区別がつくと思いますが、突然ドッキリ番組の前提でで映画のようなシチュエーションが目の前に起こってしまうとどうでしょうか?

きっと区別は難しいと思います。

さらには、まだまだ発展途上ですがApple Vison Proのようなゴーグル型のデバイスも進化によってどんどん小型化が進み、どんどん現実世界とデジタル空間の境界がぼやけてしまったときはどうなるでしょうか?

デジタル空間ではAIの力が本領発揮されます。

デジタル空間ではAIは自由自在に行動できるようになります。

デジタル空間ではAIは簡単に量産できます。

今はまだごついゴーグルをつけないと体験できないですが、技術革新によって、いずれふつうのメガネと同じくらいのデバイスで実現できるようになると思います。

ゲームでもゲームの世界に没頭する人はこれまでもいましたが、大多数の人は「現実」と「ゲーム」の区別がつけられていたと思います。

デジタル空間と現実世界の区別があいまいになるにつれて、より「現実」と「虚構」の区別をつけるのが困難になってきます。

さらに、AIの力で指数関数的に「虚構」の情報が増えていくのです。

いずれ、自分にとって「推し」の虚構が目の前に登場したときはどうなるでしょうか?

現実のものより、「虚構」の推しのほうが優先度高くなるでしょうか?

AIによって人の好みも分析されて、「虚構」優位になってくるのかもしれません。

なぜなら、人間は「虚構を信じる能力」を持っているからです。

「虚構」のほうが自分にとって、感情がゆさぶられる状態になってくれば、「現実」より「虚構」のほうが大事になっていきそうですよね。

「共感できない現実」より「共感できる虚構」のほうが大事になるのです。

人類絶滅のストーリー

冒頭のOpenAI社従業員により、人類絶滅のストーリーとしては、あっさり「自立型AIシステムの暴走」くらいしか書かれていないですが、僕としてはそのケースはたぶん可能性低いのでは。と思っています。

AIを動かしている以上はどこかのシステムで動いているので、暴走したからといって、人類が絶滅するような範囲まで波及するとは想像がつかないのです。

むしろ、エンジニアとしてはAIが暴走するとどうやって他のシステムに波及していくのか仕組みが知りたいくらいです。

それより本当に人類が滅亡に直結すると僕が思っていることは、

「人間が虚構と現実の区別ができなくなる」

ことです。

その先には「現実」より「虚構」を優先する未来が見えています。

AIが人間によって心地よい空間や、大量の「推し」を虚構空間に量産していきます。

ふつうの感覚だと「虚構」のほうが楽しくなっていくでしょう。

人間は「現実」より「虚構」を信じるようになっていきます。

地球温暖化やゴミ問題、食料問題など、人類は世界規模で多くの問題をかかえています。

噂では、AIを稼働させるコンピューティングリソース増大のおかげでエネルギーが不足する可能性がある。という情報も見かけるようになってきました。

たしかに、生成AIの盛り上がりにつれて、NVIDIAのGPUがたくさん搭載されたパソコンが大量にデータセンターで量産され続けている状態を考えると、毎日莫大な電力が消費されてるのも、たやすく想像ができます。

でも、そんな現実の問題をかかえていたとしても

「地球温暖化の悪影響のある電力消費を抑えるために、AI使うの止めよう」

とはなかなかならないですよね。

自分1人の力ではどうしようもない問題のことを考えるより、目先の「虚構」の世界で楽しく過ごせればいい。という考えが優位になってしまうからです。

そして、気が付いたときには、もう地球上ではどうしようもない状態になってしまう可能性もあるのです。

テスラのイーロン・マスクも必死に火星に人類を行かせたがっていますが、そういった背景を理解していて、人類の生き延びる道はどうしなければならないか知っているからです。

あとは、「虚構を信じる能力」によって、簡単に人を誘導できる環境も整ってきています。

オレオレ詐欺も「虚構を信じる能力」を狙ったものです。

若いうちは「現実」と「虚構」の区別はつきますが、高齢になるにともなって、電話の声だけでは区別が難しくなっていきます。

AIによって、もっとリアルな「虚構」が登場した場合はどうなるでしょうか?

それが悪意を持った「虚構」だとどうでしょうか?

人間には、現実でない「虚構」だとしても「虚構を信じる能力」を手に入れてしまったのです。

それが、AIの進化によって悪い方向にも一瞬で物事が進んでしまうリスクが高くなってきたのです。

ではどうすればいいのか?

人類に反映をもたらした「虚構を信じる能力」ですが、AIの進化によって「人類絶滅」の可能性もより現実的なものとなってきました。

さて、人間はどうすればいいのでしょうか?

デジタル空間と現実世界の融合が進むこと自体は、文明の進化でもあるのであるべき方向に進んでいるとは思いますが、一番の問題は人間の進化が文明の進化に追いついてないことだと考えています。

さすがに今から人間の進化スピードを劇的に変えることは難しいですよね。

今できることとすれば、「現実」と「虚構」の区別をつけられるようにするくらいです。

そもそも、人は日ごろ五感を通じて得た現実情報を「虚構」というフィルターを通じて認識しています。

なかなか「現実」をありのまま認識するのは意識しないと難しいです。

曇り空をみて「何か雨が降りそう」と思う時は、「虚構」で処理しています。

幸い、人間には「現実脳」と「妄想脳」という2つのモードを意識すれば切り替えることができます。

このモードの切り替えを意識してコントロールできるようにすることが重要です。

いつも心配性な人は「妄想脳」モードが暴走している状態です。

起こりもしないことに対して延々と妄想しています。

「現実脳」が弱っているときは、人に言われたことを鵜呑みにしてしまいがちになります。「妄想」が優位になってしまうからです。

AIによる「虚構」に打ち勝つには、「現実脳」モードを意識的に切り替える能力が必要になってきます。

おわりに

OpenAI社従業員の書簡「全人類絶滅の恐れ」読んで、久々にサピエンス全史の「虚構」について思い出しました。

(そして、せっかくなので妄想力を発揮して思いつくまま書いてると思いのほか長くなってしまいました)

自分のなかで過去の歴史と現在とこれからの未来がだいぶつながってきました。

たしかに、このまま何も考えずにAIが進化していくと様々なリスクが考えられます。

特に、このサピエンス全史にある「人間は虚構を信じる能力を手に入れた」という点がAIの進化にともなう大きなリスクだと考えるようになってきました。

「現実脳」と「妄想脳」の切り替えについては長くなりそうなので、別の記事にしようと思います。

入門-120x68.png)

コメント